llama.cpp - 本地大语言模型推理框架,用于在消费级硬件上高效运行LLM

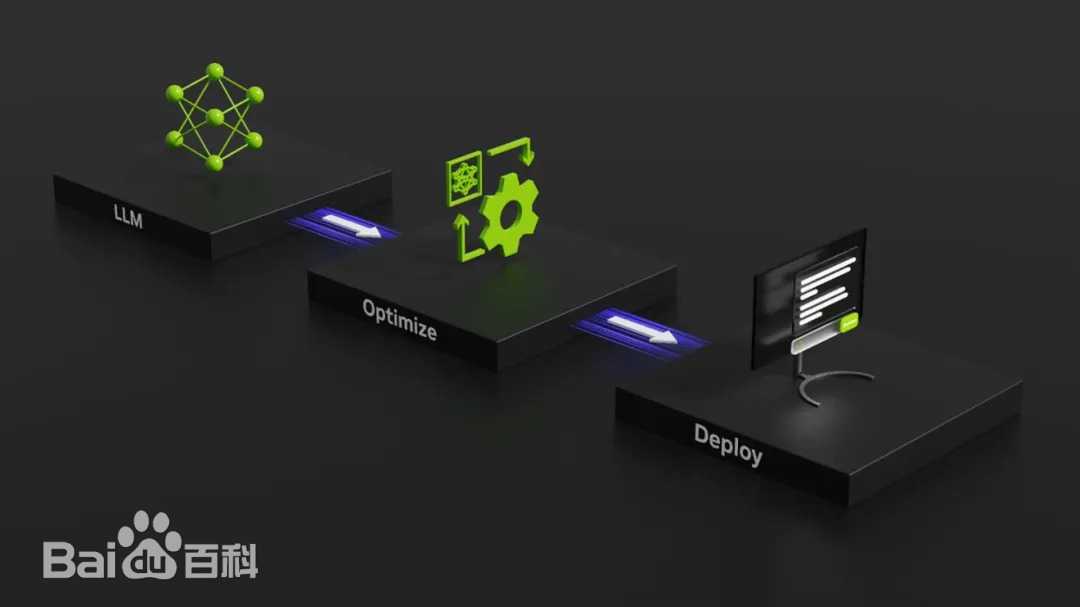

llama.cpp - 本地大语言模型推理框架,用于在消费级硬件上高效运行LLM大语言模型正在改变我们与计算机交互的方式,但通常运行这些模型需要昂贵的云端GPU和复杂的部署流程。如果你拥有一台普通的个人电脑,甚至是一台树莓派,是否也能体验和运行这些先进的AI模型?答案是肯定的。llama.cpp项目正是为了解决这个问题而生。它让你可以在自己的设备上,无需联网、无需昂贵硬件,就能运行强大的开源...