最近跟几个做独立开发的朋友聊天,发现大家的状态惊人地一致:手里都攒了一堆Agent Skill,每个单拎出来都还行,但就是感觉差点意思。

一个搜索Skill,能帮你从网上扒资料。一个总结Skill,能帮你把长文浓缩成要点。一个排版Skill,能帮你把内容整理成公众号格式。

单独用都挺好,但你想把这三个串起来——自动搜资料、自动总结、自动排版成文——突然就不灵了。要么输出格式对不上,要么中间丢了上下文,要么干脆跑飞了。

这不是某个Skill写得不好的问题,是整个玩法到了该升级的时候了。

单一Skill的天花板,你一定碰到过

先说说我自己的经历。

我之前给自己做了一套内容创作的Skill,结构大概长这样:

my-skills/

├── research-skill/ # 竞品调研

│ └── SKILL.md

├── topic-analysis-skill/ # 选题分析

│ └── SKILL.md

├── draft-generation-skill/ # 初稿生成

│ └── SKILL.md

└── title-optimizer-skill/ # 标题优化

└── SKILL.md每个Skill我都花了不少时间打磨,Prompt反复调了十几版,单独测试的时候效果都不错。

但当我试图让它们按顺序跑起来的时候,实际操作是这样的:

# 第一步:调用竞品调研Skill,手动复制输出

# 第二步:把输出粘贴到选题分析Skill的输入里

# 第三步:再把选题分析的结果喂给初稿生成...

# 第四步:最后把初稿丢给标题优化...

# 实际上你变成了一个人肉调度器:

human_dispatcher() {

research_output=$(call_skill "research""$topic")

# 手动检查一下输出对不对...

topic_output=$(call_skill "topic-analysis""$research_output")

# 再手动检查... 格式不对的话还得手动改...

draft=$(call_skill "draft-generation""$topic_output")

# 又要检查...

final=$(call_skill "title-optimizer""$draft")

}

# 四个Skill,手动调度四次,中间出问题全靠肉眼排查本来用Agent是为了省时间,结果折腾这些串联的工作比自己直接写还累。

复合式Skill:不是简单的串联,是有机的组合

我最近看到一个叫Skill Compose的开源项目(github.com/MooseGoose0701/skill-compose),虽然项目本身还处于早期阶段,但它背后的理念给了我很大的启发。

部署很简单,三步:

git clone https://github.com/MooseGoose0701/skill-compose.git

cd skill-compose/docker

cp .env.example .env # 配置你的API Key

docker compose up -d # 启动服务

# 打开 http://localhost:62600 就能用了它的核心思路是:别把Skill当成一个个孤立的工具,把它们当成可以自由组合的能力模块。搜索是一个原子Skill,阅读理解是一个原子Skill,内容提炼是一个原子Skill,格式输出又是一个原子Skill。当你需要完成一个复杂任务时,系统帮你把这些原子Skill编排成一个"复合式Skill"。

这里要强调一下"复合式"和"串联"的本质区别:

# 串联模式(线性管道,断了就全完了)

A → B → C → D

# 复合式模式(有依赖、有分支、有反馈回路)

┌→ C1 → D1

A → B ──┤

└→ C2 → D2

↑

└── 如果D2质量不达标,反馈给B重新处理

串联像流水线,一个环节卡住整条线都停;复合式像一个项目组,有人遇到问题其他人可以补位、可以协调、可以换方案。

两个复合式Skill的实战场景

光说概念太虚,我举两个我自己特别想要的场景,顺便把Skill结构写出来,方便你直观感受。

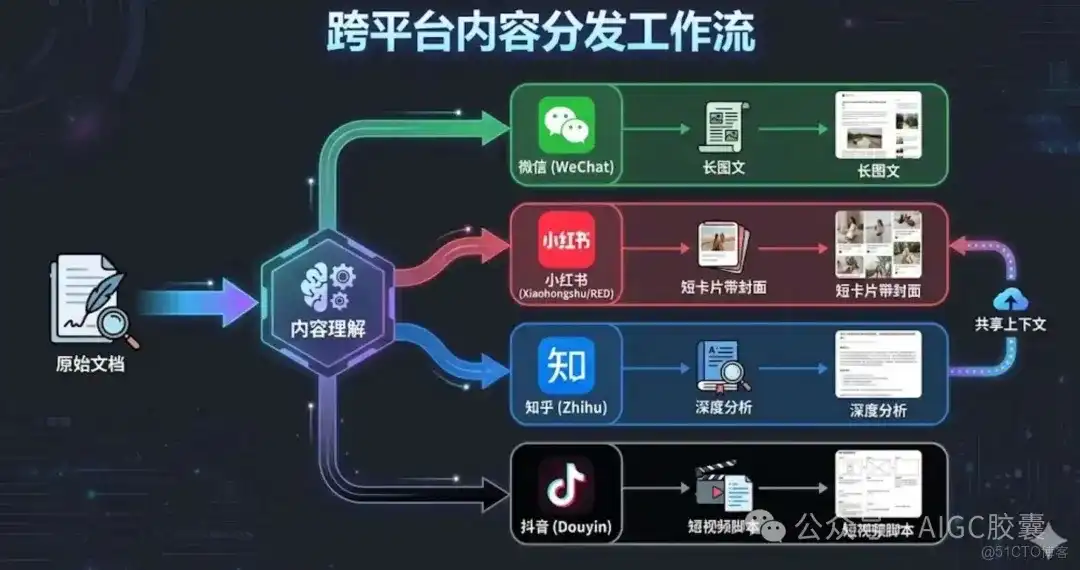

场景一:跨平台内容分发助手

做自媒体的人都知道,同一篇内容发不同平台要做大量适配。公众号要长图文,小红书要短图文加封面,知乎要深度一点,抖音文案要口语化。

单一Skill的困境:你有改写Skill、封面Skill、压缩Skill,但每发一篇内容到四个平台,你得自己手动调四轮不同的组合。

复合式Skill应该长这样:

cross-platform-publisher/

├── SKILL.md # 复合式Skill的编排描述

├── skills/

│ ├── content-parser/ # 原子Skill:内容理解,提取核心观点和素材

│ │ └── SKILL.md

│ ├── wechat-adapter/ # 原子Skill:公众号长文适配+排版

│ │ └── SKILL.md

│ ├── xiaohongshu-adapter/ # 原子Skill:小红书短文案+封面+标签

│ │ └── SKILL.md

│ ├── zhihu-adapter/ # 原子Skill:知乎深度扩写+引用补充

│ │ └── SKILL.md

│ └── cover-generator/ # 原子Skill:根据语义生成封面图

│ └── SKILL.md

└── references/

└── platform-specs.md # 各平台的内容规范参考顶层的SKILL.md里描述编排逻辑,大致是这么写的:

---

name: cross-platform-publisher

description: 将一篇原始文章自动适配并分发到多个内容平台

---## 编排流程

1. 调用 content-parser 解析原始文章,输出结构化的内容摘要

- 核心观点列表

- 关键素材和数据

- 情感基调判断

2. 根据用户指定的目标平台,并行调用对应的适配Skill:

- wechat-adapter:接收内容摘要 → 输出公众号格式长文

- xiaohongshu-adapter:接收内容摘要 → 输出短文案 + 标签列表

- zhihu-adapter:接收内容摘要 → 输出深度扩展文

3. 对需要封面的平台(小红书),调用 cover-generator

- 关键:封面Skill的输入不是原文标题,而是 content-parser

提取的核心观点,这样封面和内容语义对齐

4. 质量校验:检查各平台输出的字数是否符合 platform-specs.md

中的规范,不符合的触发对应adapter重新生成

1+1>2体现在哪?封面生成Skill参考的是内容理解Skill提取出来的核心观点,而不是瞎猜;标签推荐基于实际短文案内容,而不是原文标题。它们共享上下文,互相配合,整体质量比你一个个手动调高得多。

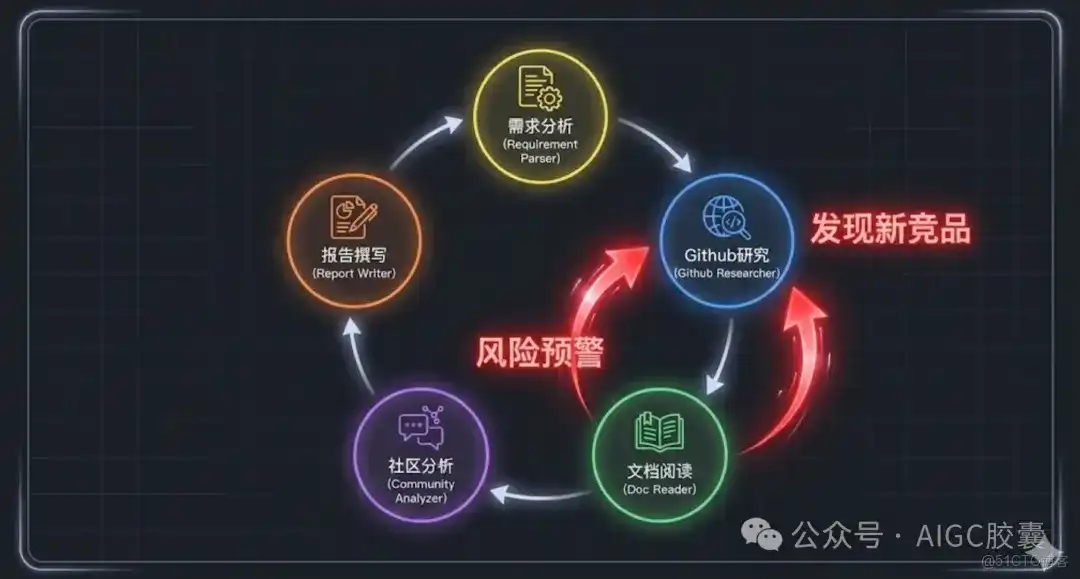

场景二:技术选型调研Agent

这是作为开发者的切身需求。每次技术选型——选消息队列、选前端框架——都要花大量时间搜集对比。

tech-evaluator/

├── SKILL.md # 复合式编排描述

├── skills/

│ ├── requirement-parser/ # 原子Skill:需求拆解

│ │ └── SKILL.md

│ ├── github-researcher/ # 原子Skill:GitHub项目搜索和分析

│ │ ├── SKILL.md

│ │ └── scripts/

│ │ └── fetch_repo_stats.py # 拉取star趋势、commit频率等

│ ├── doc-reader/ # 原子Skill:官方文档阅读和提炼

│ │ └── SKILL.md

│ ├── community-analyzer/ # 原子Skill:社区活跃度分析

│ │ ├── SKILL.md

│ │ └── scripts/

│ │ └── analyze_activity.py # 分析issue响应速度、PR合并率

│ └── report-writer/ # 原子Skill:调研报告生成

│ ├── SKILL.md

│ └── references/

│ └── report-template.md

└── references/

└── evaluation-dimensions.md # 通用评估维度参考里面的fetch_repo_stats.py做的事很实在:

# skills/github-researcher/scripts/fetch_repo_stats.py

# 拉取GitHub仓库的关键指标,供后续Skill使用

import os

import requests

from datetime import datetime, timedelta

deffetch_repo_stats(repo_url: str) -> dict:

"""返回结构化的仓库健康度数据"""

parts = repo_url.rstrip('/').split('/')

owner, repo = parts[-2], parts[-1]

headers = {"Authorization": f"token {os.environ.get('GITHUB_TOKEN', '')}"}

# 基础信息

base = requests.get(

f"https://api.github.com/repos/{owner}/{repo}",

headers=headers

).json()

# 最近6个月的commit频率

since = (datetime.now() - timedelta(days=180)).isoformat()

commits = requests.get(

f"https://api.github.com/repos/{owner}/{repo}/commits",

params={"since": since, "per_page": 100},

headers=headers

).json()

return {

"stars": base.get("stargazers_count"),

"forks": base.get("forks_count"),

"open_issues": base.get("open_issues_count"),

"last_push": base.get("pushed_at"),

"license": base.get("license", {}).get("spdx_id"),

"recent_commits_6m": len(commits),

"language": base.get("language"),

"archived": base.get("archived", False)

}复合式编排的精髓在于反馈回路。顶层SKILL.md里的编排逻辑:

## 编排流程

1. requirement-parser 将用户的模糊描述转化为结构化评估维度

输入:"帮我选一个适合中小团队的消息队列,要支持延迟消息,社区活跃"

输出:

- 必选项:延迟消息支持、社区月活跃度 > 阈值

- 权重项:学习曲线(0.3)、文档质量(0.2)、生态集成(0.2)、性能(0.3)

2. github-researcher 带着评估维度定向搜索候选方案

- 运行 fetch_repo_stats.py 获取每个候选项目的量化指标

- 过滤掉 archived=True 或 recent_commits_6m < 10 的项目

3. 对每个候选方案并行调用:

- doc-reader:阅读官方文档,提取与评估维度相关的信息

- community-analyzer:运行 analyze_activity.py 量化社区健康度

4. 【反馈回路】如果 doc-reader 在某个方案文档中发现了

对比竞品的提及(如"相比于XX,我们的优势是..."),

将该竞品反馈给 github-researcher 补充搜索

5. 【反馈回路】如果 community-analyzer 发现某方案近期

commit骤降或核心维护者离开,触发 doc-reader 去搜索

该方案的 migration guide,评估弃用风险

6. report-writer 汇总所有Skill的输出,按 report-template.md

格式生成调研报告,包含:推荐排序、风险提示、迁移成本估算你看,每个原子Skill都不复杂,fetch_repo_stats.py不过几十行代码,doc-reader本质上就是文档阅读总结。但复合起来之后,它变成了一个有判断力的调研助手——知道搜什么、知道重点看什么、发现问题还能自动补充调查。这就是1+1>2。

趋势已经很明确了

Agent Skills从"各自为战"走向"标准化+可组合"的趋势非常清晰。Anthropic去年底把Agent Skills发布为开放标准后,OpenAI的Codex直接采纳了同一套规范:

# OpenAI Codex的Skills目录结构,和Anthropic的规范完全一致

~/.codex/skills/

├── my-skill-a/

│ └── SKILL.md

└── my-skill-b/

├── SKILL.md

├── scripts/

└── references/Microsoft在VS Code和GitHub Copilot里也支持了同样的结构。大家用的是同一套SKILL.md格式,同一套YAML frontmatter元数据,同一套渐进式加载机制。积木块的尺寸终于对齐了,下一步自然就是怎么搭出更复杂的东西。

现在能做什么

趋势归趋势,现在能做的也很具体:

第一,开始有意识地拆分你手里的大Skill。

# 之前:一个Skill干所有事

writing-assistant/

└── SKILL.md # 里面塞了搜索+阅读+大纲+正文+排版的全部逻辑

# 之后:拆成原子Skill

writing-toolkit/

├── search-skill/

│ └── SKILL.md

├── reader-skill/

│ └── SKILL.md

├── outline-skill/

│ └── SKILL.md

├── drafting-skill/

│ └── SKILL.md

└── formatting-skill/

└── SKILL.md第二,给每个Skill定义清晰的输入输出契约。

---

name:content-summarizer

description:将长文本压缩为结构化摘要,保留核心观点和关键数据

---

## 输入格式

-纯文本或Markdown格式的长文内容

-可选参数:目标字数上限、保留偏好(观点优先/数据优先)

## 输出格式

-core_points:核心观点列表(不超过5条)

-key_data:关键数据和引用

-tone:原文情感基调(正面/中性/负面)

-word_count: 原文字数统计这不是多此一举。输入输出规范是未来实现自动编排的基础——如果你的Skill输入输出都是随性发挥的,任何编排系统都救不了你。

第三,关注复合式编排的进展但不急于押注。 Skill Compose这样的项目代表了有价值的方向,可以持续关注。目前更稳妥的做法是先把原子Skill的质量做好、格式标准化,等编排工具成熟了,你手里的这些高质量积木块就是最值钱的资产。

单一Skill的时代不是结束了,而是它正在成为更大棋局里的一颗棋子。真正的威力,在于组合。

- 赞

- 收藏

- 评论

- 举报

上一篇:从RAG到多智能体协同:Agent架构演进与可观测平台落地实践

下一篇:LLVM之父拆解Claude构建的C编译器:当 AI 把几十年工程实践变成默认能力,软件工程开始换玩法

提问和评论都可以,用心的回复会被更多人看到 评论 发布评论 全部评论 () 最热 最新

相关文章

[低成本抗衡DeepSeek-R1!QwQ-32B部署教程 :开源领域的“降维打击”

消费级显卡即可部署,赶紧来试试吧!

](https://blog.51cto.com/u_17285112/13580294)模型部署 QwQ 32B 算家云 应用社区 开源大模型

[低成本抗衡DeepSeek-R1!阿里重磅开源QwQ-32B,推理模型的“降维打击”来了!

3月6日,阿里宣布开源推理模型 QwQ-32B,320亿参数却实现了与 DeepSeek-R1 满血版相匹敌的性能,甚至在多项测试中实现了超越。这一突破打破了“参数规模决定性能”的固有认知,将推理能力提升至新的高度。

](https://blog.51cto.com/u_17285112/13480425)推理模型 阿里 QwQ 32B DeepSeek-R1 开源大模型

[传统数据仓库正在被 Agentic AI 吞噬?Agentic Data Stack 初探

作者 | 郭炜 白鲸开源 CEO,Apache 基金会成员摘要:从技术架构的角度看,我认为这一次的AI浪潮将深刻影响整个软件生态。DSS 系统的设计是以人作为最终消费者的决策支持逻辑为中心,然而,随着 Agentic AI 时代来临,最终的“消费者”更可能是 agent,对数据仓库和复杂 ETL 链路将被重新设计,甚至消失。传统数据仓库偏重结构与查询模式,会被 Agentic Data Stac

](https://blog.51cto.com/u_15459354/13991349)SeaTunnel

[分库分表正在被淘汰

前言“分库分表这种架构模式会逐步的被淘汰!” 不知道在哪儿看到的观点如果我们现在在搭建新的业务架构,如果说你们未来的业务数据量会达到千万 或者上亿的级别 还在一股脑的使用分库分表的架构,那么你们的技术负责人真的就应该提前退休了?如果对未来的业务非常有信心,单表的数据量能达到千万上亿的级别,请使用NewSQL 数据库,那么NewSQL 这么牛,分布库分表还有意义吗?今天虽然写的是一篇博客,但是更多的

](https://blog.51cto.com/u_16205813/14401415)MySQL 分库分表 数据库

[微积分的思维-降维打击

在工程设计中,普遍地会用到微积分来分析曲面实体的体量大小或内力分布。所以学设计的,总要掌握一些

](https://blog.51cto.com/u_15917617/5953313)微积分 算法 抽象代数 二维 2d

[来自韦神的降维打击

大家应该都听说北大的那个韦东奕韦神吧!有一件事,让我们从事认识了韦神的牛逼之处,虽然根本听不懂他们在做啥,但通过本条视频你一定会对韦神有一个全新的认识。

[pytorch使用mean降维打击

逐维 降维torch.Tensor([[[1,3],[2,3]],[[1,3],[2,3]]]).mean(2).mean(1).mean(0)

[不懂的升维思考就将面临降维打击

不懂得升维思考你就有可能面临着降维打击,拓展自己的思维模式对我们永远有益

](https://blog.51cto.com/cglt1024/3695170)杀毒软件 二级域名 二维 架构师 商业

[Agent Skill 解析

PPT分享: 分析: 一、什么是 Agent Skill(一句话定义) Agent Skill 是一种“可复用、可调度、可验证的能力单元”,它

](https://blog.51cto.com/sddai/14448555)复用 结构化 可扩展

[Agent规划大揭秘!这才是真正的planning

给定一个任务,有很多种可能的解决方法,但不是所有方法都能成功。在正确的方案中,有些比其他方案更高效。考虑这

](https://blog.51cto.com/u_15620990/13095284)人工智能 大模型 LLM ai agi

[降维打击(序列化)的流行手段

上一堂课介绍了message pack,一种非常有潜力的数据格式,市面上还有其他的格式比如json,xml,bson,甚至一些标记语言(html,markdown,yaml)和他们的字

](https://blog.51cto.com/xosg/3855968)msgpack yaml json bson utf8

[pnpm 对 npm 和 yarn 降维打击的

欢迎关注前端早茶,与广东靓仔携手共同进阶 前端早茶专注前端,一起结伴同行,紧跟业界发展步伐~ npm2 用 node 版本管理工具把 node 版本降到 4,那 npm 版本就是 2.x 了。 然后找个目录,执行下 npm init -y,快速创建个 package.json。 然后执行 npm i

](https://blog.51cto.com/feng/5734616)嵌套 硬连接 软链接

[状态压缩技巧:动态规划的降维打击

我们号之前写过十几篇动态规划文章,可以说动态规划技巧对于算法效率的提升非常可观,一般来说都能把指数级和阶乘级时间复杂度的算法优化成 O(N^2),堪称算法界的二向箔,把各路魑魅魍魉统统打成二次元。但是,动态规划本身也是可以进行阶段性优化的,比如说我们常听说的「状态压缩」技巧,就能够把很多动态规划解法的空间复杂度进一步降低,由 O(N^2) 降低到 O(N),能够使用状态压缩技巧的动态规划都是二维d

[“升维的降维打击”-参数训练的驻点分析

讨论深度学习参数训练失败的原因,结合具体的案例分析参数为驻点时的情形,并通过理论推导的方式证明.讨论逃离鞍点进一步更新的方法,最后揭示深度学习模型实现降维打击效果的原因.

](https://blog.51cto.com/u_14278341/6020590)损失函数 深度学习 机器学习 参数训练 算法

[读博后降维打击数学建模!

Datawhale干货作者:小雨姑娘,康涅狄格大学,Datawhale成员文章来自知乎提问:如何评价 202

](https://blog.51cto.com/u_15699042/5524681)人工智能 java 机器学习 python 算法

[小学数学题升维思考,降维打击

首先升高维度,将线变成面再次定义边界,多少种可能?向前进几位?十位是否可以为

](https://blog.51cto.com/u_15845711/6193163)升维思考降维打击 结构化 二维

[DFS序和欧拉序的降维打击

1. DFS 序和时间戳1.1 DFS 序定义:树的每一个节点在深度优先遍历中进、出栈的时间序列。如下树的 dfs 序就是[1,2,8,8,5,5,2,4,3,9,9,3,6,6,4,7,7,1]。下图为生成DFS的过程。对于一棵树进行DFS序,除了进入当前节点时对此节点进行记录,同时在回溯到当前节点时对其也记录一下,所以DFS序中一个节点的信息会出现两次。Tips: 因为在树上深度

](https://blog.51cto.com/gkcode/8548537)割点 #include 子树

[React Server Components | 首屏渲染的降维打击

之前在重构千万级流量的电商首页时,我用React Server Components(RSC)创造了首屏加载耗时从3.2s→0.8s的优化奇迹。今天先带大家掌握RSC的核心武器库,揭秘实战中遇到的5个

](https://blog.51cto.com/jima/14090200)前端 AI编程 服务端 客户端 缓存

[打造高效易用的Agent Skill

Agent 不缺能力,缺的是"知道该怎么做"。Skill 就是把你的经验、流程和最佳实践,变成 Agent 可以反复调用的知识包。

](https://blog.51cto.com/u_15082365/14504009)Agent Skill Coding Agent AgenticWorkflow PromptEngineering

[java skill java skills

Basic Java Skills1. Java的工作方式:源代码文件(.java)→编译器产出字节码(.class)→JVM读取与执行字节码cmd运行java文件: 输入: &n

](https://blog.51cto.com/u_12855/7593359)java skill java jvm 开发语言 构造器

[PostgreSQL数据库应用:基于GIS的实时车辆位置查询

这段代码实现了一个简单的实时交通监控系统视图:追踪每辆车的最新位置,并匹配到最近道路查询:统计每条道路上的车辆数量,识别拥堵道路这样的系统可用于:交通管理部门监控实时路况导航系统提供拥堵信息城市规划分析道路使用情况。

](https://blog.51cto.com/u_16099264/14503133)#机器学习 #算法 #人工智能 sql 表数据

[云计算的核心技术全解读 - 好文

在容器化技术日益普及的今天,如何高效管理分散的Docker服务成为运维人员面临的重要挑战。Homarr通过其精心设计的API架构,完美解决了这一痛点。本文将深入解析Homarr API如何基于tRPC和OpenAPI技术栈,构建出类型安全、易于扩展的现代化服务管理平台。## 为什么选择Homarr API:解决传统管理工具的三大痛点传统服务器管理工具往往面临配置复杂、类型错误频发、扩展性不

](https://blog.51cto.com/u_16213667/14503212)API Docker 解决方案

[Java -- 通过EWS JAVA API读取exchange邮件\_ews-java-api

想要快速访问和操作Office 365、Exchange Online或Exchange Server邮箱中的各种数据吗?EWS Java API为你提供了完整的解决方案。这个强大的Java客户端库让开发者能够通过简单的代码调用,实现邮件收发、日程管理、联系人维护等复杂功能。## ? 项目核心功能详解EWS Java API不仅仅是一个简单的邮件访问工具,它提供了全方位的Exchange

](https://blog.51cto.com/u_16213647/14503250)API Java java

[欧拉系统如何装docker

这里写自定义目录标题欢迎使用Markdown编辑器新的改变功能快捷键合理的创建标题,有助于目录的生成如何改变文本的样式插入链接与图片如何插入一段漂亮的代码片生成一个适合你的列表创建一个表格设定内容居中、居左、居右SmartyPants创建一个自定义列表如何创建一个注脚注释也是必不可少的KaTeX数学公式新的甘特图功能,丰富你的文章UML 图表FLowchart流程图导出与导入导出导入 欢迎使用M

](https://blog.51cto.com/u_16099165/14503442)欧拉系统如何装docker Markdown 流程图 代码片

[【金猿技术展】一种松耦合的分布式高性能工作流任务调度系统——数新网络解决大数据统一调度问题...

在当今AI技术快速发展的时代,分布式AI Agent系统已成为解决复杂问题的重要工具。然而,随着Agent数量和复杂度的增加,传统集中式通信架构面临着诸多挑战:消息延迟、单点故障、扩展性瓶颈等问题日益凸显。本文将从分布式系统设计的角度,深入解析如何构建高效、可靠的AI Agent通信架构。## 问题分析:分布式AI Agent通信的核心挑战### 通信延迟与吞吐量瓶颈在分布式AI Ag

](https://blog.51cto.com/u_16213706/14504261)序列化 消息路由 风控

Generated by Clearly Reader

暂无评论